Mối nguy hại của Deepfake trong thời đại số

Deepfake là công nghệ sử dụng trí tuệ nhân tạo (AI) để lấy hình ảnh, giọng nói của một người ghép vào video của người khác. Deepfake được biết đến rộng rãi vào tháng 12/2017, sau khi một người dùng có tên "DeepFakes" đã đăng các video khiêu dâm về những người nổi tiếng trên diễn đàn thảo luận nổi tiếng Reddit.

- Deep-learning - Công nghệ mang đến hy vọng mới trong điều trị ung thư

- FaceApp - Giải mã nguyên nhân khiến người dùng "say như điếu đổ"

- Xuất hiện ứng dụng FaceApp giả mạo chuyên cài cắm mã độc

Nguy hiểm và tinh vi hơn cả fake news (tin tức giả), công nghệ Deepfake với khả năng cắt ghép khuôn mặt và hủy hoại danh tiếng của một cá nhân, tập thể chỉ với vài nút bấm. Bất cứ ai cũng có thể trở thành nạn nhân của vấn nạn Deepfake, đặc biệt là phụ nữ, người nổi tiếng và chính trị gia - nhóm đối tượng dễ bị lợi dụng nhất.

Deepfake là gì?

Thực tế Deepfake là video làm giả khuôn mặt, giọng nói của mọi người thông qua các thuật toán "học sâu" (deep learning) có khả năng thay thế những đặc điểm nhận dạng của một cá nhân bằng người khác. Deepfake làm xuất sắc tới mức mọi thứ trông giống hệt như thật mà không mấy ai nghi ngờ.

Deepfake là thuật ngữ được tạo nên với sự kết hợp giữa "Deep Learning" và "Fake" (giả mạo), là một kỹ thuật tổng hợp hình ảnh con người dựa trên trí tuệ nhân tạo (AI).

Về bản chất, công nghệ Deepfake được xây dựng trên nền tảng công nghệ học máy (Machine Learning) mã nguồn mở của hãng công nghệ Google. Sau khi quét các video và ảnh chân dung của một người cụ thể, Deepfake sẽ hợp nhất hình ảnh với video riêng biệt nhờ công nghệ AI và thay thế các chi tiết trên gương mặt như mắt, miệng, mũi với chuyển động gương mặt, giọng nói giống như thật. Càng có nhiều video và hình ảnh gốc, thì AI càng hoạt động chính xác và video giả mạo có độ chân thực cao.

Đối với các tập tin âm thanh, deepfake sử dụng bản ghi âm giọng nói của một người thực để huấn luyện máy tính nói chuyện giống hệt người ấy.

Sự kết hợp giữa video hiện có và video nguồn để tạo ra một video giả mạo hiển thị một người hoặc nhiều người đang thực hiện một hành động tại một sự kiện chưa bao giờ thực sự xảy ra.

Mối nguy hiểm của Deepfake trong lừa đảo tiền số

Với công nghệ ngày càng tinh vi, Deepfake ngày càng khó phát hiện và có thể được sử dụng cho nhiều loại tội phạm, khiến chúng trở nên nguy hiểm hơn trên môi trường internet.

Video deepfake phỏng vấn Elon Musk được đăng trên kênh YouTube BitVex.

Như vụ việc mới đây, một kẻ lừa đảo tạo một sàn giao dịch tiền số, dùng video deepfake những người nổi tiếng như Elon Musk để quảng bá và đánh lừa người dùng.

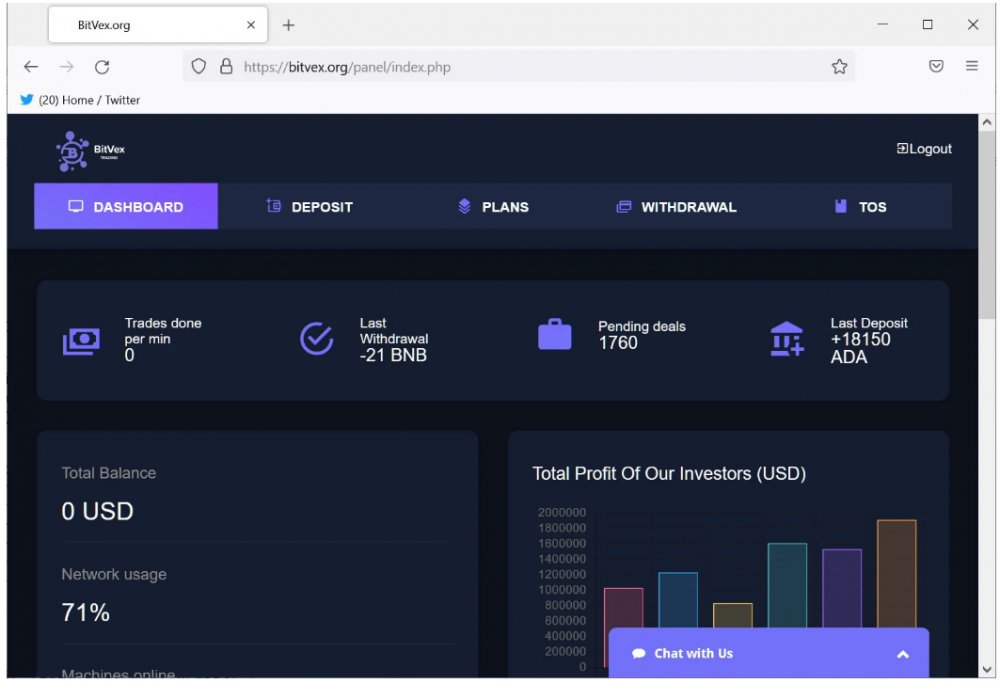

Theo Bleeping Computer, kẻ gian tạo một sàn tiền điện tử có tên BitVex và nói rằng người dùng có thể gửi tiền số để thu về 30% lợi nhuận mỗi ngày, thậm chí có thể hơn nếu số tiền gửi càng lớn.

Ở phần giới thiệu, trang này nêu các đồng sáng lập bao gồm tỷ phú Elon Musk, CEO Binance Changpeng Zhao và CEO quỹ đầu tư Ark Invest Cathie Wood. Tuy nhiên, những tên tuổi này chưa bao giờ thông báo là người sáng lập BitVex.

Các video giả mạo người nổi tiếng xuất hiện trên tính năng video ngắn Shorts của YouTube. Ảnh: gigazine.

Để tăng độ "uy tín", nền tảng thậm chí còn đăng nhiều video deepfake về các nhân vật nổi tiếng trong giới tiền số như Musk, Wood, Brad Garlinghouse, Michael Saylor và Charles Hoskinson lên các nền tảng video như Vimeo, YouTube. Một số tài khoản YouTube thậm chí đã bị tấn công chiếm quyền điều khiển để phát những video này.

Chẳng hạn, trong video "phỏng vấn Musk" trên YouTube, nhân vật có khuôn mặt giống tỷ phú công nghệ Mỹ nói đã đầu từ 50 triệu USD vào BitVex. Tuy nhiên, khi xem kỹ video, phần lồng tiếng, biểu cảm khuôn mặt lẫn nội dung phỏng vấn được Bleeping Computer nhận xét là "ngớ ngẩn đến mức hài hước".

BitVex cho phép người dùng đăng ký và gửi tiền số. Giống như hầu hết các trò gian lận tương tự, website hiển thị các lần rút tiền gần đây của nhiều loại tiền điện tử khác nhau nhằm tạo sự tin tưởng. Dù vậy, một phân tích cho thấy đây chỉ là các đoạn mã JavaScript được hiển thị ngẫu nhiên và sẽ thay đổi sau mỗi lần làm mới trang.

Bleeping Computer kiểm tra địa chỉ tiền điện tử được công bố dưới dạng tài khoản BitVex. Ảnh: gigazine

Hiện trò lừa đảo này chưa quá thành công khi mới có 1.700 USD tiền số đã được gửi vào địa chỉ của kẻ lừa đảo. Tuy nhiên, do các địa chỉ này thường xuyên thay đổi, kẻ tấn công có thể đã thu về số tiền nhiều hơn.

Đây không phải là lần đầu tên tuổi của Elon Musk và người nổi tiếng trong giới tiền số bị lợi dụng. Tháng 1 năm ngoái, kẻ gian tạo website giả mạo nói về việc Musk tặng tiền điện tử, sau đó lừa hàng nghìn người và kiếm về hơn 580.000 USD chỉ sau một tuần.

Đầu tháng này, một video deepfake thảo luận và kêu gọi đầu tư tiền số giữa Elon Musk, Jack Dorsey và Cathie Wood đăng trên YouTube cũng khiến nhiều người tưởng thật. Kẻ gian sau đó đã thu về 1,3 triệu USD từ nạn nhân.

Với việc tiền số ngày càng phổ biến, các trò lừa đảo liên quan đến loại hình này cũng tăng mạnh thời gian qua. Theo thống kê của Chainalysis đầu năm nay, tổn thất do tội phạm liên quan đến tiền số năm 2021 đã tăng 79% so với 2020, lên 14 tỷ USD, chủ yếu do hành vi trộm cắp và lừa đảo tăng đột biến. Trong đó, lừa đảo là hình thức phổ biến nhất, sau đó là trộm cắp - hầu hết xảy ra thông qua việc hack các doanh nghiệp tiền điện tử.

Tự bảo vệ mình trước công nghệ Deepfake

Các nhà khoa học cho rằng, càng nhiều hình ảnh, video cá nhân được đăng lên Internet thì khả năng bị làm giả danh tính bằng Deepfake càng cao. Để hạn chế đến mức thấp nhất khả năng bị làm giả danh tính, trước mắt, mỗi cá nhân hãy tự khống chế số lượng người có thể xem video và hình ảnh của chính mình.

Rõ ràng, Deepfake đã trở thành vấn nạn trên thế giới, khiến nhiều người bị lâm vào tình cảnh khó khăn sau khi bị phát tán những những đoạn video giả mạo trên mạng.

Tại Việt Nam, không ít người vẫn vô tư chia sẻ những bức ảnh cá nhân, với khuôn mặt rõ nét lên mạng xã hội ở chế độ công khai. Bởi lối suy nghĩ chủ quan cho rằng, Deepfake là chuyện xa vời, xảy ra ở đâu đó chứ không ảnh hưởng tới mình, vì họ không phải người nổi tiếng hay là chính trị gia. Tuy nhiên, hãy nhớ rằng bất kỳ ai cũng có thể biến bức ảnh, bản ghi âm, video thành những đoạn phim giả mạo nhằm làm mất uy tín, sỉ nhục, quấy rối hoặc chơi xấu và dùng vào mục đích tống tiền người khác.

Theo Tạp chí Điện tử

Tối thiểu 10 chữ Tiếng việt có dấu Không chứa liên kết

Gửi bình luận